Оптимизация контента для SEO

Оптимизация контента для SEO

Оптимизация контента под SEO - более доступная альтернатива позиционированию.Каждый владелец блога, веб-сайта или электронного бизнеса хочет, чтобы ...

Любой крупный интернет-проект — это живой организм. На маркетплейсах, в масштабных интернет-магазинах или на крупных информационных порталах ежедневно создаются, удаляются и редактируются сотни страниц. В таких условиях структура сайта неизбежно начинает давать трещины в виде битых ссылок, цепочек редиректов и нерелевантных исходящих линков.

Любой крупный интернет-проект — это живой организм. На маркетплейсах, в масштабных интернет-магазинах или на крупных информационных порталах ежедневно создаются, удаляются и редактируются сотни страниц. В таких условиях структура сайта неизбежно начинает давать трещины в виде битых ссылок, цепочек редиректов и нерелевантных исходящих линков.

Отсутствие контроля за состоянием ссылочной массы внутри сайта ведет к ухудшению пользовательского опыта (UX), масштабной потере краулингового бюджета (поисковые роботы тратят лимиты на сканирование несуществующих страниц) и просадке позиций в поисковой выдаче.

В этой статье мы разберем, как выстроить эффективный и автоматизированный процесс контроля ссылок на большом сайте, чтобы техническое состояние ресурса всегда оставалось на высоте.

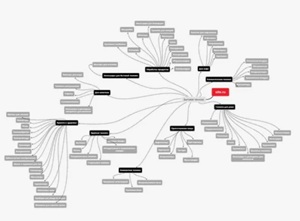

Прежде чем выстраивать регулярный процесс, нужно понять масштаб трагедии. Первым шагом всегда является полный технический аудит (парсинг) сайта.

Что необходимо найти:

Для первичного сканирования больших сайтов (от 100 000 страниц и более) лучше всего подходят десктопные краулеры (Screaming Frog SEO Spider, Netpeak Spider) с использованием серверных мощностей, либо облачные решения (Sitebulb Cloud, Ahrefs Site Audit).

Устранение «мертвых» ссылок не должно быть разовой акцией — это должно стать рутиной. Правильная обработка ошибок и неработающих линков — фундамент технического SEO. Как отмечает профильный источник, работа с битыми ссылками является базовой гигиеной для успешного продвижения ресурса и поддержания его здоровья.

Регламент обработки битых ссылок должен быть следующим:

На большом сайте невозможно проверять ссылки вручную. Процесс должен быть автоматизирован.

Процесс контроля ссылок не будет работать, если за него отвечает абстрактный «кто-то». В компании должен быть четкий SOP (Standard Operating Procedure) и распределение обязанностей:

Помимо внутренних процессов, важно контролировать внешнюю среду сайта.

rel="nofollow".Построение процесса контроля ссылок на большом сайте сводится к трем основным компонентам: поиск (аудит) -> автоматизированный мониторинг -> оперативная ликвидация проблем командой по регламенту.

Сделав этот процесс регулярным, вы улучшите поведенческие факторы, поможете поисковикам быстрее индексировать важный контент и сохраните накопленный ссылочный вес, что неминуемо приведет к росту органического трафика.